Предположим, что:

1) Y = Xb + e;

2) X – детерминированная матрица размерности nхk, имеющая максимальный ранг k;

3) E(e) = 0; V(e) = E(ee`) = s2In.

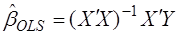

Тогда оценка метода наименьших квадратов

является наиболее эффективной (в смысле наименьшей дисперсии) оценкой в классе линейных несмещенных оценок.

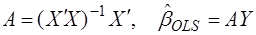

Доказательство. Обозначим  .

.

Любую другую линейную оценку b можно без ограничения общности представить в виде b = (A + C)Y, где C - некоторая матрица размерности nхk.

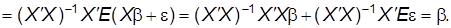

1. Покажем, что МНК-оценка (см. уравнение (46)) является несмещенной оценкой b:

(49)

(49)

Из условия несмещенности оценки b получаем, что для всех b справедливо соотношение

b = Eb = (A + C)EY = (A + C)Xb = (I + CX)b,

откуда следует, что CX = 0.

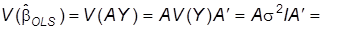

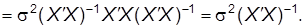

2. Подсчитаем матрицу ковариаций МНК-оценки:

(50)

(50)

(Здесь мы использовали симметричность матрицы X`X).

3. Используя полученное выше равенство CX = 0, получаем

b - b = (A + C)Y - b = (A + C)Xb + (A + C)e - b = AXb - b + CXb +

+ (A + C)e = (A + C)e, так как CX = 0 и AX = 1.

Вычислим теперь матрицу ковариаций вектора b:

V(b) = E((b - b)(b - b)`) = E((A +C)ee`(A + C)`) = (A + C)s2I (A + C)`=

= s2 [AA` + CA` + AC` + CC`] = s2 [(X`X)-1 X`X (X`X)-1 +

+ CX (X`X)-1 + (X`X)-1 X`C` + CC`] = s2(X`X)-1 + s2CC`.

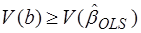

Таким образом (см. формулу (50)),

V(b) = V(bols) + s2CC`.

Матрица CC` неотрицательно определена, поэтому

. (51)

. (51)

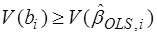

Отсюда следует утверждение теоремы. В самом деле, i-й диагональный элемент матрицы V(b) равен дисперсии i-й компоненты вектора коэффициентов V(bi). Поэтому из (51) следует соответствующее неравенство для дисперсий оценок коэффициентов регрессии

,

,

что и требовалось доказать.

2014-02-24

2014-02-24 768

768