Теорема Гаусса-Маркова формулирует условия, при которых МНК позволяет

получить наилучшие оценки параметров линейной модели множественной регрессии.

Теорема начинается с описания условий, которые накладываются на вектор

случайных возмущений. Эти условия принято называть предпоссылками теоремы Гаусса- Маркова.

И так. Если:

1.Математическое ожидание случайных возмущений во всех наблюдениях равно нулю: M(Ū|X)=0

2. Дисперсия случайных возмущений во всех наблюдениях одинакова и равна константе su: s2(Ū|X)= su2

3.Ковариация между парами случайных возмущений в наблюдениях равны нулю

(случайные возмущения в наблюдениях независимы): cov(ui,uj)=0 (i≠j)

4.Ковариация между вектором регрессоров и вектором случайных переменных равнa нулю(регрессоры и случайные возмущения независимы): cov( )=0

)=0

Тогда. Если матрица Х неколлинеаная:

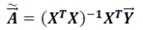

1. Наилучшая оценка вектора параметров линейной модели множественной регрессии вычисляется, как:

Она соответствует методу наименьших квадратов

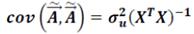

2. Ковариационная матрица оценок параметров модели вычисляется как:

2. Ковариационная матрица оценок параметров модели вычисляется как:

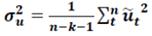

3. Дисперсия случайного возмущения равна:

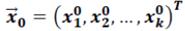

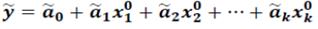

4. Наилучший прогноз модели в точке  вычисляется по

вычисляется по

правилу:

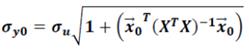

5. Ошибка прогноза эндогенной переменной равна:

2015-05-18

2015-05-18 460

460