Чтобы рассматривать понятие информации с точки зрения математики, нам нужна определенная величина, годящаяся для измерения количества информации. Впервые эту проблему сформулировал и решил Хартли (Hartley) в 1928 г., изучая телеграфную связь. Хартли заметил, что если вероятность того, что некоторое событие произойдет, высока (близка к 1), неуверенность в том, что это событие произойдет, невелика. Если впоследствии мы узнаем, что это событие произошло, то количество полученной нами информации будет невелико. Таким образом, внушающей доверие мерой информации может служить величина, обратная вероятности некоего события, — 1/р. Например, если происходит событие, вероятность которого равна 0,25, то мы получаем больше информации, чем если произойдет событие, вероятность которого равна 0,5. Если мера информации равна 1/р, тогда первое событие обладает информацией 4 (1/0,25), а количество информации о втором событии равно 2 (1/0,5). Но в использованиии этой меры количества информации есть трудности:

|

|

|

· Эта единица измерения, кажется, «не работает» с последовательностями событий. Рассмотрим двоичный источник, генерирующий поток из единиц и нулей с равной вероятностью значения каждого бита. Таким образом, каждый бит несет количество информации, равное 2 (1/0,5). Но если бит b1 несет в себе 2 единицы информации, то сколько информации содержится в строке из двух битов b1 b2? Эта строка может содержать одну из четырех возможных комбинаций битов, причем каждое из четырех значений строка может принимать с вероятностью 0,25. Таким образом, при использовании в качестве меры количества информации величину 1/р два бита будут содержать четыре единицы информации. Продолжая данные рассуждения, количество информации, содержащееся в трех битах (b1,b2,b3), равно восьми. Это означает, что первые два бита, b1 и b 2, несут по две единицы информации, а третий бит (b3) добавляет сразу четыре единицы информации. Следующий бит (b4) добавит к последовательности уже восемь единиц информации и т. д. Это не кажется разумным.

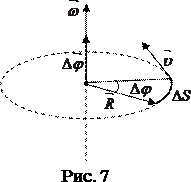

Рассмотрим событие, приводящее к изменению двух или более независимых переменных. Примером такого события может быть сигнал, кодируемый при помощи так называемого метода фазовой манипуляции, для которого используется четыре возможных фазы и две амплитуды. Один элемент такого сигнала содержит две единицы информации для амплитуды и четыре для фазы, итого шесть единиц. В то же время, каждый элемент сигнала может иметь восемь возможных значений, и поэтому должен соответствовать восьми единицам информации, если пользоваться принятой нами мерой. Хартли разрешил данную проблему, прологарифмировав данную величину, то есть он предложил в качестве меры количества информации события х функцию log(1/ Р(х)), где Р(х) означает вероятность события х. Формально можно написать:

I(x) = log (1/Р(х)) = - log P(x)

Эта мера количества информации «работает» и позволяет получить множество полезных результатов.

2014-02-02

2014-02-02 653

653